Video-on-Demand

Video-on-Demand (VOD) in Google Cloud

Entdecken Sie ein End-to-End-System zur Videoverbreitung für On-Demand-Streaming – alles an einem Ort. Mit einer VOD-Infrastruktur, die auf Aufnahme, Speicherung, Transcodierung und Bereitstellung ausgelegt ist, können Sie globale Zielgruppen im richtigen Moment erreichen.

Überblick

Was ist VOD?

Video-on-Demand (VOD) ist ein Medienvertriebssystem, mit dem Nutzer Videoinhalte gemäß ihren Präferenzen ansehen können, ohne dass dabei statische Zeitpläne oder bestimmte Videowiedergabegeräte vorgegeben sind.

Was ist der Unterschied zwischen VOD und Livestreaming?

VOD-Streaming ist nicht dasselbe wie Livestreaming. VOD-Inhalte beruhen auf vorab aufgezeichneten und bearbeiteten Videoinhalten, bevor der Nutzer sie sich ansieht. Beim Livestreaming werden Live-Videoinhalte in Echtzeit bereitgestellt.

Welche Arten von Video-on-Demand gibt es?

Die VOD-Technologie (Video-on-Demand) stellt vorab aufgezeichnete und bearbeitete Videoinhalte direkt für einzelne Kunden bereit. Unternehmen können Anzeigen in VOD-Assets einfügen, um Inhalte im Rahmen ihrer Video-on-Demand-Werbestrategie (AVOD) zu monetarisieren. Weitere VOD-Monetarisierungsstrategien sind die Berechnung einer monatlichen Gebühr für On-Demand-Abos (SVOD) oder einmalige Zahlungen für den Zugriff auf bestimmte transaktionale Video-on-Demand-Streams (TVOD) und Livestreams (z. B. Pay-per-View).

Wie funktioniert Video-on-Demand?

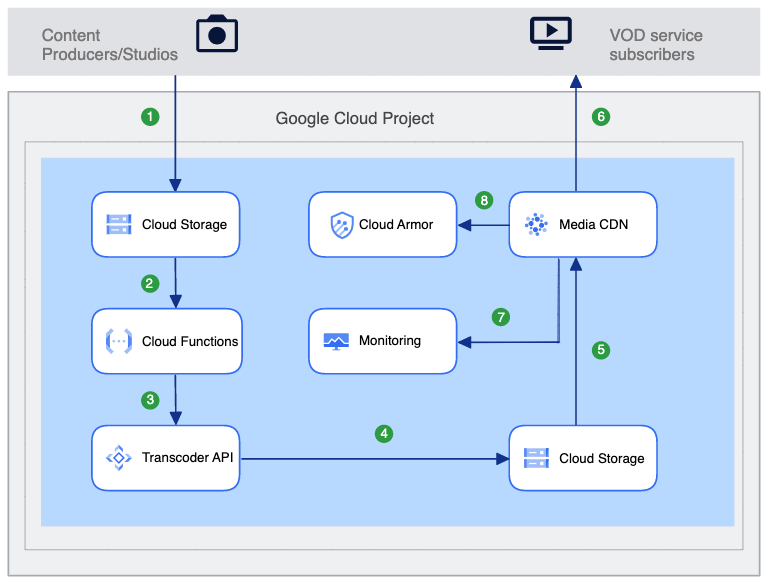

VOD wird über Content Delivery Networks (CDNs) wie Media CDN ausgeführt, die gestreamte Videoinhalte weltweit im Cache speichern und verteilen. Mezzanine-Videoinhalte wird in Storage-Buckets aufgenommen, für Streaming in mehreren Formaten transcodiert, zur Herkunft in Buckets gespeichert, von CDNs verteilt und von Videoanwendungen wiedergegeben.

Welche Vorteile bietet Video-on-Demand?

VOD bietet Unternehmen mehr Zuverlässigkeit und geringere Kosten, was zu höheren Umsätzen, besseren Web-Erlebnissen und einer höheren Nutzerfreundlichkeit beitragen kann. Mit der skalierbaren und automatisierten VOD-Lösung von Google Cloud können Sie Videos aufnehmen, speichern, transcodieren, erstellen und streamen – alles an einem Ort.

Wie funktioniert VOD mit Google Cloud?

Die Infrastruktur, die Google in den letzten zehn Jahren für über 2 Milliarden YouTube-Nutzer verwendet hat, wird mittlerweile für die Bereitstellung von Medien in großem Maßstab, einschließlich VOD-Lösungen, für Google Cloud-Kunden mit Media CDN genutzt. Die Infrastruktur von Google Cloud umfasst mehr als 200 Länder und Gebiete sowie mehr als 1.300 Städte auf der ganzen Welt. Damit wird die Entfernung zwischen Videoinhalten und Nutzern verkürzt, was eine höhere Bitrate und weniger Zwischenspeicherung ermöglicht.

Video-on-Demand-Plattform

Videoinhalte mit Media CDN bereitstellen

Hier erfahren Sie, wie Sie mit Google Cloud-Produkten und ‑Infrastruktur einen End-to-End-Workflow für das VOD-Streaming erstellen. Neue Videoinhalte werden in Cloud Storage aufgenommen, mit der Transcoder API transcodiert und mit Media CDN weltweit über einen HLS/MPEG-DASH-kompatiblen Videoplayer wiedergegeben.

Anleitungen

Videoinhalte mit Media CDN bereitstellen

Hier erfahren Sie, wie Sie mit Google Cloud-Produkten und ‑Infrastruktur einen End-to-End-Workflow für das VOD-Streaming erstellen. Neue Videoinhalte werden in Cloud Storage aufgenommen, mit der Transcoder API transcodiert und mit Media CDN weltweit über einen HLS/MPEG-DASH-kompatiblen Videoplayer wiedergegeben.

VOD-Inhalte transcodieren

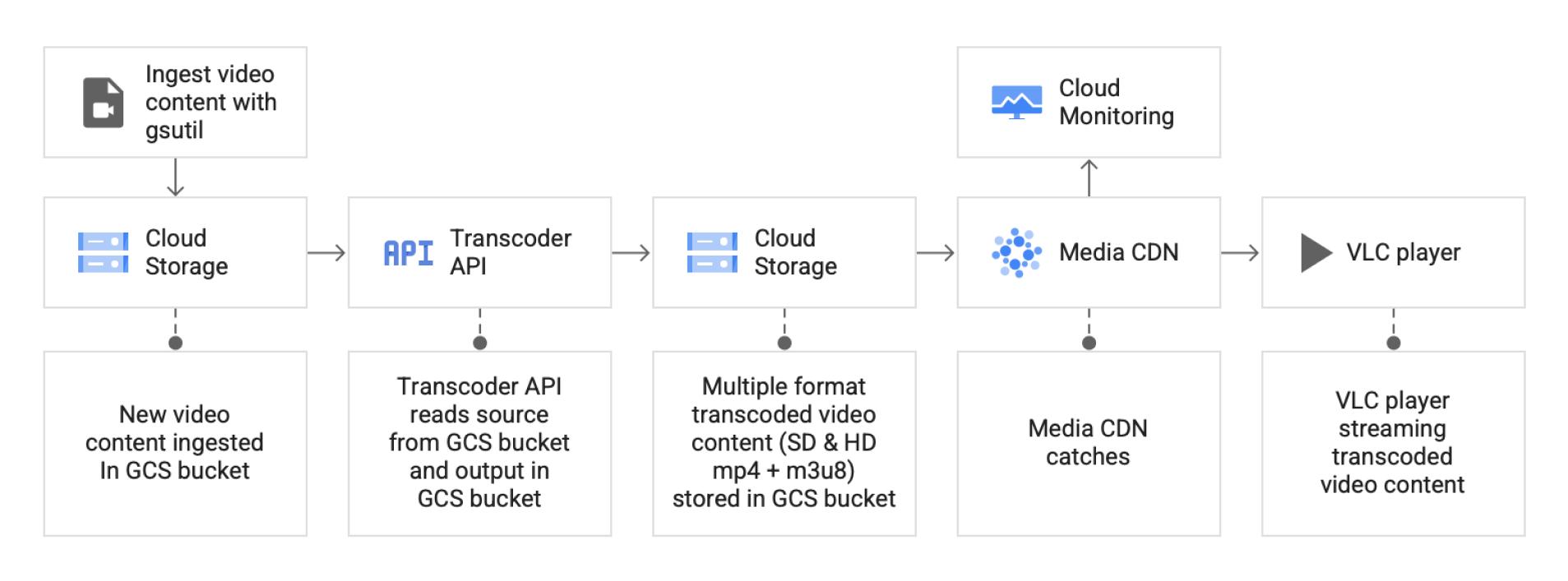

Video mit der Transcoder API transcodieren

Die Transcoder API transcodiert aufgenommene Video-Mezzanine-Dateien in die gewünschten Ausgabeformate, einschließlich MP4, HLS und MPEG-DASH. Für jedes Eingabevideo liefert die Transcoder API Ausgabewiedergaben basierend auf Ihrer Konfiguration: SD (weniger als 1280 x 720 Pixel) bis HD (1280 x 720 Pixel) bis UHD (mehr als 1920 x 1080 bis 4096 x 216 Pixel) , Die transcodierten Videos werden in einem separaten Cloud Storage-Bucket abgelegt, der als Ursprungsspeicher für Media CDN dient.

Anleitungen

Video mit der Transcoder API transcodieren

Die Transcoder API transcodiert aufgenommene Video-Mezzanine-Dateien in die gewünschten Ausgabeformate, einschließlich MP4, HLS und MPEG-DASH. Für jedes Eingabevideo liefert die Transcoder API Ausgabewiedergaben basierend auf Ihrer Konfiguration: SD (weniger als 1280 x 720 Pixel) bis HD (1280 x 720 Pixel) bis UHD (mehr als 1920 x 1080 bis 4096 x 216 Pixel) , Die transcodierten Videos werden in einem separaten Cloud Storage-Bucket abgelegt, der als Ursprungsspeicher für Media CDN dient.

Videotranscodierung automatisieren

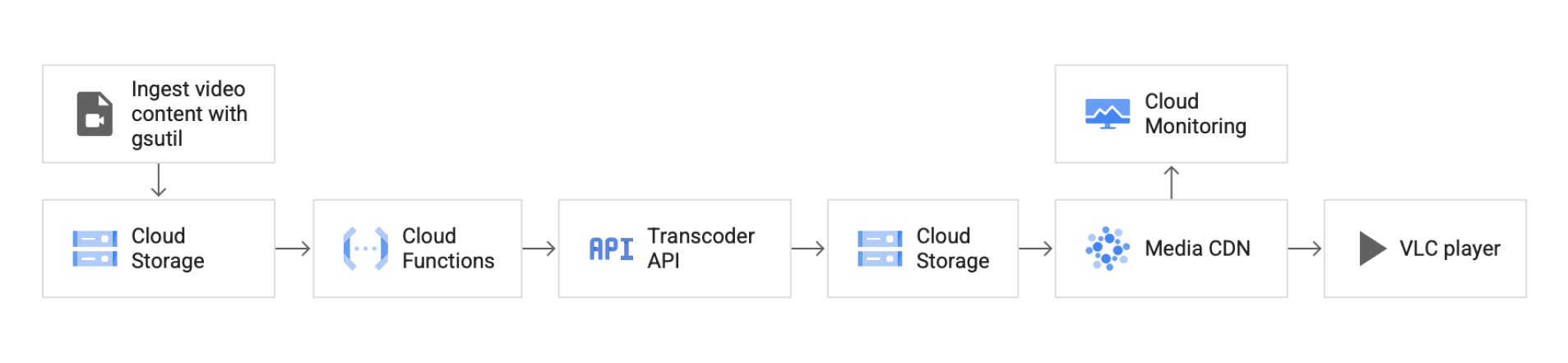

Transcodierungsvorgänge mit Cloud Functions automatisieren

Sobald Videodateien in Cloud Storage aufgenommen wurden, erkennt Cloud Functions automatisch ein neues Video im Bucket und erstellt den Transcodierungsjob. Die Transcoder API transcodiert aufgenommene Video-Mezzanine-Dateien in die gewünschten Ausgabeformate, einschließlich H.264-Codierung sowie MP4-, HLS- und MPEG-DASH-Paketerstellung. Die resultierenden transcodierten Dateien werden in einem separaten Cloud Storage-Bucket abgelegt, der als Ursprungsspeicher für Media CDN dient.

Anleitungen

Transcodierungsvorgänge mit Cloud Functions automatisieren

Sobald Videodateien in Cloud Storage aufgenommen wurden, erkennt Cloud Functions automatisch ein neues Video im Bucket und erstellt den Transcodierungsjob. Die Transcoder API transcodiert aufgenommene Video-Mezzanine-Dateien in die gewünschten Ausgabeformate, einschließlich H.264-Codierung sowie MP4-, HLS- und MPEG-DASH-Paketerstellung. Die resultierenden transcodierten Dateien werden in einem separaten Cloud Storage-Bucket abgelegt, der als Ursprungsspeicher für Media CDN dient.

Livestreams transkodieren

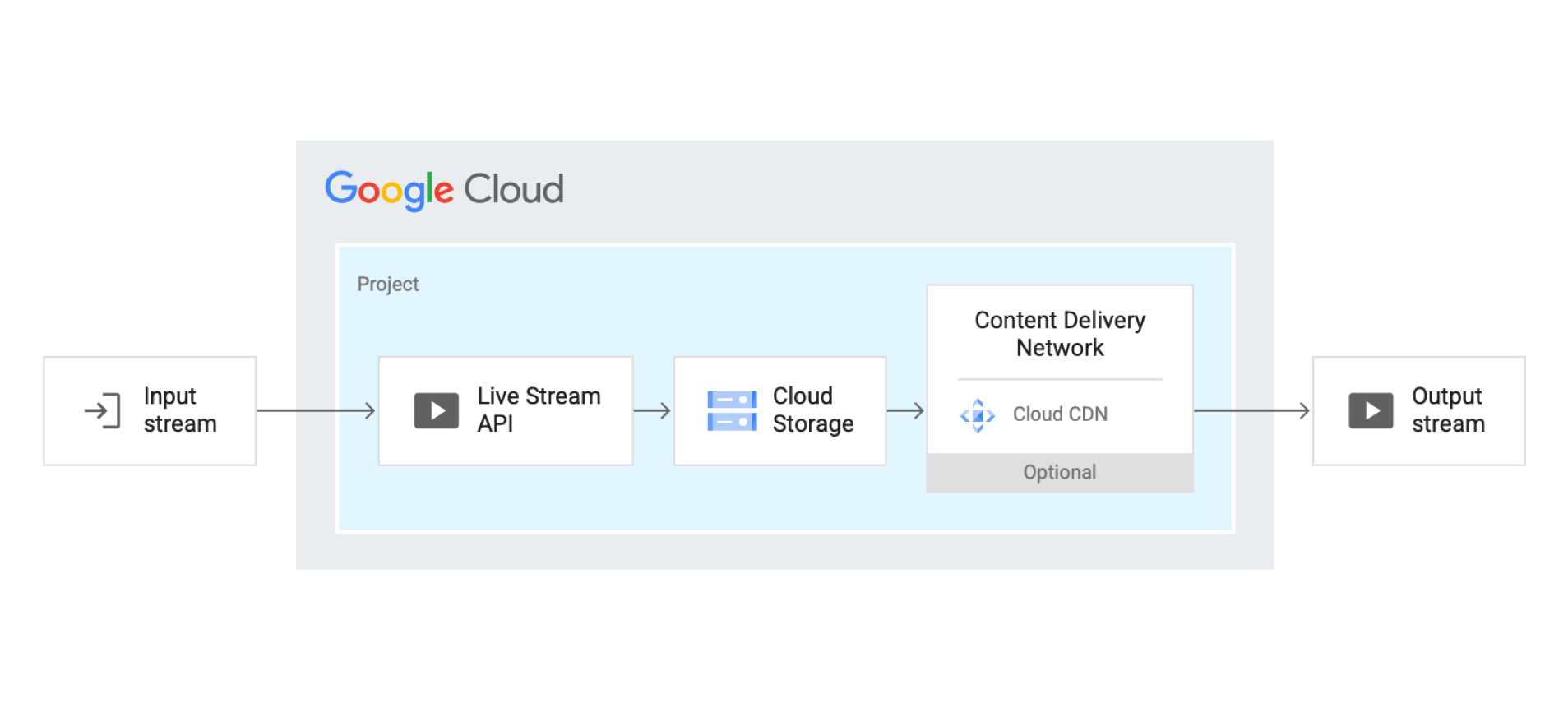

Livestream mit der Live Stream API transcodieren

Die Live Stream API transcodiert automatisch Mezzanine-Live-Signale in Streamingformate für Endnutzer, einschließlich HLS und MPEG-DASH. Richten Sie zuerst einen Eingabeendpunkt ein und erstellen Sie dann eine Kanalressource, die den SRT- oder RTMP-Livestream in einen HLS- oder DASH-Ausgabestream transkodiert. Von der Live Stream API erstellte Ausgabestreams werden in Cloud Storage-Buckets gespeichert, die als Backend für Cloud CDN konfiguriert werden können.

Anleitungen

Livestream mit der Live Stream API transcodieren

Die Live Stream API transcodiert automatisch Mezzanine-Live-Signale in Streamingformate für Endnutzer, einschließlich HLS und MPEG-DASH. Richten Sie zuerst einen Eingabeendpunkt ein und erstellen Sie dann eine Kanalressource, die den SRT- oder RTMP-Livestream in einen HLS- oder DASH-Ausgabestream transkodiert. Von der Live Stream API erstellte Ausgabestreams werden in Cloud Storage-Buckets gespeichert, die als Backend für Cloud CDN konfiguriert werden können.

Videoanzeigen für VOD

Anzeigen mit der Video Stitcher API in VOD-Inhalte einfügen

Fügen Sie Anzeigen, die auf Ad-Servern gespeichert und durch Metadaten beschrieben werden, in VOD-Inhalte ein. Dadurch werden Monetarisierungsstrategien für VOD-Inhalte nahtlos unterstützt. Die Video Stitcher API unterstützt die folgenden Formate: Common Media Application Format (CMAF)-konformes HTTP Live Streaming (HLS) und Dynamic Adaptive Streaming over HTTP (DASH) als Standard für adaptives Streaming mit variabler Bitrate. Nach dem Aufruf erstellt die API eine neue VOD-Sitzung, in der die Wiedergabe-URL und Informationen zu den in das Video eingefügten Anzeigen angegeben werden.

Anleitungen

Anzeigen mit der Video Stitcher API in VOD-Inhalte einfügen

Fügen Sie Anzeigen, die auf Ad-Servern gespeichert und durch Metadaten beschrieben werden, in VOD-Inhalte ein. Dadurch werden Monetarisierungsstrategien für VOD-Inhalte nahtlos unterstützt. Die Video Stitcher API unterstützt die folgenden Formate: Common Media Application Format (CMAF)-konformes HTTP Live Streaming (HLS) und Dynamic Adaptive Streaming over HTTP (DASH) als Standard für adaptives Streaming mit variabler Bitrate. Nach dem Aufruf erstellt die API eine neue VOD-Sitzung, in der die Wiedergabe-URL und Informationen zu den in das Video eingefügten Anzeigen angegeben werden.

Videoanzeigen für Livestreams

Anzeigen in einen Livestream einfügen

Ähnlich wie bei VOD-Inhalten werden bei Livestream-Inhalten mit der Video Stitcher API Anzeigen dynamisch eingefügt, die durch Metadaten beschrieben werden, die auf Ad-Servern gespeichert sind. Die Video Stitcher API unterstützt die folgenden Formate: Common Media Application Format (CMAF)-konformes HTTP Live Streaming (HLS) und Dynamic Adaptive Streaming over HTTP (DASH) als Standard für adaptives Streaming mit variabler Bitrate. Nach dem Aufruf erstellt die API eine neue Live-Sitzung, in der die Wiedergabe-URL und Informationen zu den in das Video eingefügten Anzeigen angegeben werden.

Anleitungen

Anzeigen in einen Livestream einfügen

Ähnlich wie bei VOD-Inhalten werden bei Livestream-Inhalten mit der Video Stitcher API Anzeigen dynamisch eingefügt, die durch Metadaten beschrieben werden, die auf Ad-Servern gespeichert sind. Die Video Stitcher API unterstützt die folgenden Formate: Common Media Application Format (CMAF)-konformes HTTP Live Streaming (HLS) und Dynamic Adaptive Streaming over HTTP (DASH) als Standard für adaptives Streaming mit variabler Bitrate. Nach dem Aufruf erstellt die API eine neue Live-Sitzung, in der die Wiedergabe-URL und Informationen zu den in das Video eingefügten Anzeigen angegeben werden.

Video Intelligence für VOD

VOD-Inhalte mit der Video Intelligence API annotieren

Mit der Video Intelligence API können Entwickler die Videoanalysetechnologie von Google in ihre Anwendungen einbinden. Vortrainierte Modelle für maschinelles Lernen erkennen in gespeicherten und live gestreamten Videos automatisch eine Vielzahl von Objekten, Orten und Aktionen. Mit der REST API können Nutzer lokal oder in Cloud Storage gespeicherte Videos mit Kontextinformationen auf Ebene des gesamten Videos, pro Segment, pro Aufnahme und pro Frame annotieren.

Anleitungen

VOD-Inhalte mit der Video Intelligence API annotieren

Mit der Video Intelligence API können Entwickler die Videoanalysetechnologie von Google in ihre Anwendungen einbinden. Vortrainierte Modelle für maschinelles Lernen erkennen in gespeicherten und live gestreamten Videos automatisch eine Vielzahl von Objekten, Orten und Aktionen. Mit der REST API können Nutzer lokal oder in Cloud Storage gespeicherte Videos mit Kontextinformationen auf Ebene des gesamten Videos, pro Segment, pro Aufnahme und pro Frame annotieren.

Video Intelligence für Livestreams

Liveinhalte mit der Video Intelligence API annotieren

Die Video Intelligence API ermöglicht die Streaminganalyse von Live-Medien in Echtzeit. Vortrainierte Modelle für maschinelles Lernen erkennen in gespeicherten und live gestreamten Videos automatisch eine Vielzahl von Objekten, Orten und Aktionen. Mit der REST API können Nutzer Videos kommentieren, die in Cloud Storage gespeichert sind oder live gestreamt werden. Außerdem unterstützt sie standardmäßige Livestreaming-Protokolle wie RTSP, RTMP und HLS. Kontextinformationen werden für das gesamte Video, pro Segment, pro Aufnahme und pro Frame zur Verfügung gestellt.

Anleitungen

Liveinhalte mit der Video Intelligence API annotieren

Die Video Intelligence API ermöglicht die Streaminganalyse von Live-Medien in Echtzeit. Vortrainierte Modelle für maschinelles Lernen erkennen in gespeicherten und live gestreamten Videos automatisch eine Vielzahl von Objekten, Orten und Aktionen. Mit der REST API können Nutzer Videos kommentieren, die in Cloud Storage gespeichert sind oder live gestreamt werden. Außerdem unterstützt sie standardmäßige Livestreaming-Protokolle wie RTSP, RTMP und HLS. Kontextinformationen werden für das gesamte Video, pro Segment, pro Aufnahme und pro Frame zur Verfügung gestellt.